Le projet ASETIAH (Accélérer, Sécuriser, ÉTendre l’Intelligence Artificielle par des méthodes Hybrides) est un projet de recherche ONERA, visant à développer et utiliser des techniques hybrides pour accélérer, sécuriser et étendre le savoir-faire existant.

Il a été lancé en janvier 2024, et est coordonné par Xavier Pucel, chercheur à l'ONERA.

Objectifs

Les techniques dites d’IA hybride cherchent à combiner des approches d’IA symbolique avec des approches utilisant l’apprentissage afin de tirer parti des avantages de chaque côté. Le projet ASETIAH (Accélérer, Sécuriser, ÉTendre l’Intelligence Artificielle

par des méthodes Hybrides) vise à utiliser ces techniques hybrides pour accélérer, sécuriser et étendre le savoir-faire existant. Accélérer dans le sens où les techniques d’apprentissage peuvent augmenter les performances des outils basés sur des techniques symboliques, et vice-versa. Sécuriser en proposant des garanties de performances ou de robustesse, des domaines de fonctionnement, ou des explications de comportement pour des modèles générés par apprentissage. ÉTendre pour utiliser des informations semi-structurées dans des approches symboliques.

L’apport de ces nouvelles techniques est évalué sur des cas d’application existants.

Organisation

Le projet est organisé autour de 3 axes scientifiques :

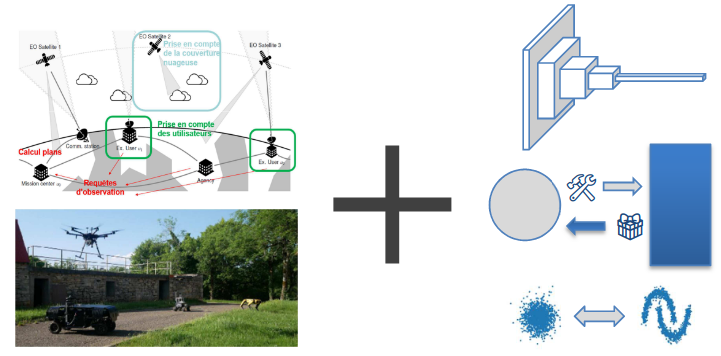

- Les algorithmes de décision, et leurs applications à l’industrie 4.0, aux constellations de satellites, et aux systèmes multi-robots. Les défis relevés sont d’améliorer les performances des outils de décision, de tenir compte d’incertitudes, ou d’adapter un algorithme de décision à ses conditions d’exploitation.

- L’adaptabilité des systèmes et modèles, notamment pour la maintenance de modèles construits par apprentissage, la conception collaborative, et la maintenance de modèles utilisés pour l’optimisation. Les défis abordés sont

l’adaptabilité et la traçabilité des modèles construits par apprentissage, l’interprétation de modèles semi-formels, et l’évaluation et la maintenance d’un modèle symbolique à l’aide de techniques d’apprentissage. - Les modèles intrinsèquement explicables, parce qu’ils raisonnent sur des informations naturellement explicites (texte, image), ou à l’inverse parce qu’ils respectent par construction une structure et un raisonnement logique imposé (réseaux neuro-flous ou bayésiens profonds). Les défis de cet axe sont liés aux cadres d’apprentissage et aux contraintes qu’ils imposent : complexité des modèles, exigences pour l’entraînement, utilisation pour modéliser un phénomène, interprétation du modèle.

Le projet supporte également des activités d’animation ayant pour but de former, échanger, et acculturer les participants à l’état de l’art des techniques d’apprentissage.

Responsable

Xavier Pucel (DTIS)